Articol scris de Izabela Matei, Marketing Manager și AI Adoption Enthusiast

Riscurile de securitate ale datelor în AI: cum folosești AI în business fără să expui informații sensibile

Ai încărcat vreodată documentul primit de la un client într-un tool AI doar ca să „îi faci un rezumat rapid”? Nu ești singurul. Și exact asta e problema.

AI-ul a devenit parte din munca de zi cu zi. Îl folosim pentru emailuri, analiză de date sau generare de conținut. Pe de o parte este adevărat că ne ajută să ne mișcăm mai rapid, dar nu ține pasul protecția datelor.

Contracte sensibile, date financiare, conversații interne – toate pot ajunge, printr-un simplu prompt, în sisteme pe care nu le controlezi. Realitatea este incomodă: majoritatea tool-urilor AI nu sunt construite pentru securitate enterprise.

Întrebarea nu este dacă ar trebui să folosim AI, ci cum îl folosim fără să pierdem controlul asupra datelor?

Pentru a răspunde, trebuie să înțelegem ce se întâmplă în spate și cum se diferențiază platforme precum Microsoft Copilot de restul tool-urilor de pe piață.

LLM-uri, agenți AI și Agentic AI explicate simplu

Termenul de „AI” are o utilitate vastă, dar în realitate există mai multe componente distincte.

La bază sunt LLM-urile (Large Language Models) – modele precum GPT, capabile să înțeleagă și să genereze text.

Peste acestea se construiesc agenții AI – sisteme care nu doar generează răspunsuri, ci pot executa acțiuni: rezumă documente, trimit emailuri sau automatizează procese.

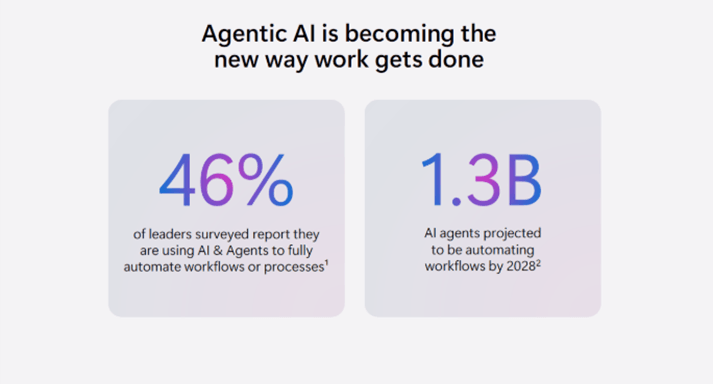

Mai nou a apărut conceptul de Agentic AI – sisteme care nu doar răspund, ci planifică, iau decizii și execută taskuri în mod autonom, pe mai multe aplicații și fluxuri de lucru.

Microsoft estimează că această evoluție va automatiza procesele la scară largă în următorii ani.

De ce adopția AI crește rapid, dar securitatea rămâne în urmă?

AI nu mai este un experiment, ci a fost integrat în modul de lucru al companiilor din toată lumea.

Angajații folosesc AI pentru:

- redactarea emailurilor

- analiza datelor

- generarea de rapoarte

- automatizarea proceselor repetitive

Microsoft numește această schimbare „Agentic System of Work” – un model în care AI devine parte din activitatea zilnică, nu doar un tool punctual.

Problema este că adopția depășește guvernanța.

Majoritatea tool-urilor AI:

- nu înțeleg structura organizației tale

- nu respectă drepturile de acces interne

- nu sunt integrate cu politicile tale de securitate

Rezultatul? Câștigi viteză, dar pierzi controlul. Iar acest dezechilibru generează mai multe riscuri de securitate.

Cine este responsabil pentru securitatea datelor în AI? (Nu doar IT-ul)

Riscurile asociate cu folosirea AI sunt adesea tratate ca o problemă exclusiv tehnică, dar în realitate ele depășesc zona IT.

Liderii de business adoptă AI pentru a crește eficiența și a reduce fricțiunea operațională. Fiecare decizie de introducere a AI în procese influențează direct modul în care datele sunt utilizate.

Echipele IT rămân responsabile pentru guvernanță, securitate și conformitate. Ele trebuie să se asigure că politicile sunt respectate și că există vizibilitate asupra modului în care datele sunt folosite.

Inginerii și arhitecții au un rol esențial în integrarea AI în sisteme. Ei definesc fluxurile de date, controalele aplicate și punctele potențiale de expunere.

Pe măsură ce AI devine parte din activitatea noastră zilnică, aceste roluri devin din ce în ce mai interdependente. Deciziile dintr-o zonă – fie ele de business, tehnice sau operaționale – au impact direct asupra securității datelor.

Dacă organizația ta utilizează sau intenționează să utilizeze AI, acest subiect nu mai este opțional. Este o responsabilitate comună care necesită coordonare la nivelul întregii companii.

Riscurile ascunse ale utilizării tool-urilor AI publice în business

Majoritatea platformelor AI publice (precum ChatGPT, Google Gemini sau Anthropic Claude) funcționează pe baza unui model simplu:

- utilizatorul introduce date într-un prompt

- cererea este trimisă către un serviciu AI extern

- modelul procesează datele

- este generat un răspuns.

Din punct de vedere al utilizării, acest model este extrem de eficient. Din perspectiva securității și guvernanței, însă, vine cu riscuri semnificative, care sunt adesea ignorate.

Ce se întâmplă, de fapt, cu datele tale?

Atunci când un angajat introduce conținut într-un tool AI public, în mod normal se întâmplă următoarele:

- datele sunt transmise în afara mediului organizației

- sunt procesate intr-o infrastructură asupra căreia nu ai control

- pot fi logate, stocate temporar sau cache-uite

- nu sunt evaluate conform politicilor interne de securitate.

Chiar dacă furnizorii declară că datele nu sunt utilizate pentru antrenarea modelelor, acest lucru nu înseamnă automat că datele nu sunt stocate temporar, cererea nu este logată undeva sau conținutul generat nu este accesibil în scopuri de debugging sau optimizare. Din perspectiva IT, acest lucru creează a blind spot.

Cum poate afecta folosirea AI securitatea datelor companiei tale?

Majoritatea organizațiilor investesc implementează protocoale de control precum:

- acces bazat pe identitate (cine și ce poate accesa);

- clasificarea datelor (ce date sunt sensibile și în ce măsură);

- politici DLP (unde se duc datele);

- audit și monitorizare (cine a accesat și a transmis date).

Tool-urile AI publice ocolesc aceste mecanisme.

Exemplu:

Un document din SharePoint poate fi:

- accesibil doar unui anumit grup;

- etichetat drept confidențial;

- protejat prin politici DLP.

În momentul în care conținutul este introdus într-un tool AI public:

- aceste protocoale nu mai sunt aplicate;

- clasificarea dispare

- limitele de acces nu mai există

În practică, datele devin simplu text într-un sistem extern.

Pierderea vizibilității și a controlului

Din perspectiva operațiunilor IT, una dintre cele mai mari probleme este lipsa de vizibilitate.

În cazul utilizării tool-urilor AI publice, nu există:

- un sistem centralizat de logging al prompturilor;

- vizibilitate asupra datelor care au fost partajate;

- posibilitatea de audit sau investigare a utilizării;

- aplicarea unor politici de retenție sau ștergere a datelor.

Acest lucru devine critic în scenarii precum incidente de securitate, audituri de conformitate sau investigații legale.

Dacă date sensibile au fost expuse printr-un tool AI, majoritatea organizațiilor nu știu ce informații au fost partajate, de către cine și în ce moment.

Exemplu real: scurgerea de date Samsung (2023)

În 2023, inginerii Samsung au expus neintenționat date sensibile în timp ce foloseau un tool AI public pentru a-și eficientiza munca. Printre informațiile introduse s-au numărat coduri-sursă ale unor aplicații Samsung, note din întâlniri interne și date operaționale.

Aceste informații au fost introduse direct în sistemul AI, în afara mediului controlat al companiei. După mai multe incidente de acest tip, Samsung a restricționat utilizarea tool-urilor de tip generative AI la nivel intern. Acest exemplu evidențiază cât de ușor pot fi transmise în afara unei organizații datele sensibile, în lipsa unor mecanisme adecvate de guvernanță.

De ce folosesc angajații tool-uri AI neaprobate și de ce nu se vor opri curând?

Chiar și în organizații bine administrate, angajații tind să adopte constant tool-uri care le fac munca mai rapidă și mai ușoară. Atunci când sistemele existente introduc fricțiune – fie prin procese lente, funcționalități limitate sau controale de acces complexe – oamenii caută alternative care îi ajută să fie mai eficienți.

Tool-urile AI sunt deosebit de eficiente în eliminarea acestei fricțiuni. Ele oferă rezultate rapide cu efort minim, ceea ce le face extrem de atractive în activitatea de zi cu zi.

Acest comportament este adesea interpretat ca o problemă de training sau conformitate. În realitate, este în primul rând o problemă de design al sistemelor.

Dacă soluțiile sigure și aprobate nu sunt ușor accesibile, intuitive și integrate în fluxurile de lucru existente, angajații vor alege în mod natural varianta care îi ajută să își finalizeze sarcinile mai eficient.

Din perspectiva securității, acest lucru este previzibil. Comportamentul orientat către productivitate va avea întotdeauna prioritate, dacă alternativa sigură nu este și cea mai practică.

De aceea, controlul utilizării AI nu înseamnă restricționarea accesului, ci oferirea unor alternative guvernate, care se aliniază cu modul real în care oamenii lucrează.

De ce este Microsoft Copilot mai sigur pentru datele de business decât tool-urile AI publice

Spre deosebire de majoritatea tool-urilor AI publice, Microsoft Copilot nu este conceput ca o interfață separată. Este integrat direct în ecosistemul Microsoft 365, ceea ce înseamnă că funcționează în același mediu în care există deja utilizatorii, datele și politicile tale de securitate.

Copilot nu se bazează pe input-uri izolate. El funcționează în contextul organizației tale – utilizatori, permisiuni, fișiere și fluxuri de lucru. În loc să trateze fiecare cerere ca text independent, utilizează Microsoft Graph pentru a înțelege modul în care sunt structurate datele și cine are drept de acces la acestea.

Din perspectiva utilizatorului, acest lucru îl face mai util. Din perspectiva securității, îl face semnificativ mai sigur.

Cu toate acestea, este important de reținut că, deși Copilot este, prin design, mai sigur, nu este automat sigur în orice tenant. Nivelul de securitate depinde în continuare de modul în care mediul IT este configurat.

1. Ce înseamnă acest lucru în practică?

Cel mai important avantaj al Copilot este că datele tale rămân în interiorul mediului organizației.

Atunci când un utilizator interacționează cu Copilot – fie în Outlook, Teams, Word sau Excel – datele sunt procesate în cadrul tenantului Microsoft 365. Ele nu sunt copiate într-un tool extern și nu sunt gestionate în afara limitelor de control ale organizației tale.

Acest lucru are câteva implicații directe:

În primul rând, Copilot respectă modelul existent de permisiuni. Dacă un utilizator nu are acces la un document, Copilot nu îl poate accesa sau expune. Nu există scurtături în ceea ce privește controlul accesului și nici un „layer AI” care să ocolească setările de securitate.

În al doilea rând, toate politicile de securitate existente continuă să se aplice. Mecanisme precum Conditional Access, Data Loss Prevention (DLP) și etichetele de sensibilitate sunt aplicate automat. Dacă un document este clasificat ca fiind confidențial sau are restricții de partajare externă, aceste reguli rămân valabile și în interacțiunile cu Copilot.

Există însă câteva nuanțe importante care sunt adesea trecute cu vederea:

- etichetele de sensibilitate nu blochează automat procesarea în Copilot dacă nu sunt corelate cu politici DLP;

- permisiunile prea largi pot duce în continuare la expunerea datelor sensibile.

Cu alte cuvinte, nivelul de securitate depinde în mod direct de configurația tenantului.

În al treilea rând, interacțiunile cu datele rămân vizibile și auditabile. Spre deosebire de tool-urile AI publice, unde utilizarea este adesea în afara vizibilității IT, Copilot oferă un nivel mult mai ridicat de audit și monitorizare, chiar dacă gradul de acoperire depinde de workload și configurație.

2. Dincolo de securitate, cum îmbunătățește Copilot și productivitatea?

Aceste mecanisme de securitate nu sunt importante doar pentru reducerea riscurilor, ci permit și o utilizare mai eficientă a AI-ului.

Deoarece Copilot funcționează în interiorul mediului tău IT, acesta poate să:

- rezume documente interne fără a le expune în exterior

- genereze rapoarte folosind date reale din cadrul companiei

- redacteze emailuri pe baza contextului, întâlnirilor și a fișierelor tale

- ofere asistență în conversațiile din Teams, folosind informații relevante din organizație.

Cu alte cuvinte, Copilot nu generează doar răspunsuri generice, ci lucrează direct cu datele tale reale, în siguranță.

Aceasta este o diferență esențială. Tool-urile AI publice necesită ca utilizatorii să ofere manual contextul, de multe ori prin introducerea unor informații sensibile. Copilot elimină acest pas, reducând în același timp atât fricțiunea, cât și riscul.

3. Construit pentru guvernanță, nu doar pentru acces

O altă diferență importantă este că Microsoft Copilot este conceput pentru a fi gestionat ca parte a unui sistem enterprise.

Organizațiile pot:

- controla cine are acces la funcționalitățile Copilot

- monitoriza gradul de adopție și modul de utilizare

- aplica politici de guvernanță asupra utilizatorilor și datelor

- măsura impactul utilizării AI asupra business-ului.

Aceste funcționalități se aliniază cu abordarea Microsoft asupra AI, în care securitatea, conformitatea și managementul sunt integrate direct în platformă, nu adăugate ulterior.

Cum securizezi utilizarea AI în business: ce trebuie să implementeze IT-ul de la început?

Securizarea utilizării AI într-un context de business pornește de la un principiu clar: AI nu este un add-on. Este parte din infrastructura ta. Și ca orice sistem critic, trebuie proiectat și gestionat corespunzător.

În practică, acest lucru înseamnă alinierea utilizării AI cu aceleași controale care guvernează restul mediului IT.

Totul începe cu protocoale de control al accesului și identității. Fiecare interacțiune cu AI este asociată unui utilizator, ceea ce face esențială aplicarea unor mecanisme solide de autentificare și limitarea accesului. Multi-Factor Authentication (MFA) și politicile de Conditional Access asigură faptul că doar utilizatorii de încredere, din locații și de pe dispozitive conforme, pot accesa datele companiei. Privileged Identity Management (PIM) reduce riscul acordării unor drepturi excesive, oferind acces privilegiat doar atunci când este necesar.

Următorul nivel este securitatea endpoint-urilor. AI este accesat de pe dispozitivele utilizatorilor, ceea ce înseamnă că acestea trebuie să respecte standarde clare de securitate. Soluții precum Microsoft Intune și Microsoft Defender asigură faptul că doar dispozitivele conforme și protejate pot accesa resursele companiei, reducând riscul de scurgere a datelor de pe dispozitive compromise sau neadministrate.

Al treilea pilon este protecția datelor și a comunicațiilor. Politicile Data Loss Prevention (DLP) ajută la prevenirea partajării informațiilor sensibile în afara canalelor aprobate, fie că vorbim de email, Teams sau alte platforme de colaborare. Acest aspect devine esențial în contextul AI, unde datele sunt frecvent procesate și transformate.

La fel de importantă este guvernanța datelor. Organizațiile trebuie să înțeleagă ce date dețin, cât de sensibile sunt și cine ar trebui să aibă acces la ele. Etichetele de sensibilitate, controlul partajării externe și clasificarea structurată a datelor asigură faptul că sistemele AI interacționează cu informațiile într-un mod controlat și predictibil.

În final, vizibilitatea și monitorizarea sunt critice. Utilizarea AI trebuie să fie observabilă. Echipele IT trebuie să poată urmări modul în care sunt utilizate aceste tool-uri, să auditeze tiparele de acces și să identifice din timp potențiale riscuri. Fără acest nivel de control, chiar și mecanismele bine implementate pot fi ocolite.

Unde aduce valoare Optimizor

Deși aceste principii sunt clare la nivel teoretic, implementarea lor corectă nu este simplă.

Majoritatea organizațiilor folosesc deja Microsoft 365, însă în realitate aceste medii sunt adesea doar parțial configurate. Permisiunile sunt prea largi, politicile sunt aplicate inconsistent, iar guvernanța este mai degrabă reactivă decât structurată.

Aici intervine valoarea pe care o aduce Optimizor.

Cu peste 20 de ani de experiență în Microsoft 365 și expertiză practică în domenii precum identitate, securitate și automatizare, Optimizor ajută organizațiile să treacă de la un setup de bază la un mediu controlat, pregătit pentru adoptarea AI. Acest lucru include:

- revizuirea și restructurarea modelelor de acces

- implementarea corectă a politicilor de Conditional Access și PIM

- configurarea politicilor DLP și a clasificării datelor în funcție de nevoile business-ului

- securizarea endpoint-urilor prin Intune și Defender

- definirea unor mecanisme de guvernanță și monitorizare pentru utilizarea AI.

Dincolo de configurare, accentul este pus pe adopția practică. AI nu ar trebui implementat izolat, ci integrat în procesele existente într-un mod care să fie atât sigur, cât și eficient.

Aici devine esențială combinația dintre expertiza în Microsoft și înțelegerea tehnică a AI. Aceasta permite organizațiilor nu doar să își protejeze datele, ci și să utilizeze AI în mod eficient, fără a introduce riscuri inutile.

AI în business: un avantaj competitiv doar dacă este controlat

AI face deja parte din modul în care operează companiile moderne. Întrebarea reală nu mai este dacă să îl adopți, ci dacă mediul tău este pregătit să îl susțină în siguranță.

Tool-uri precum Microsoft Copilot fac posibilă utilizarea AI în cadrul sistemelor existente, fără ca datele să părăsească mediul organizației. Cu toate acestea, rezultatul depinde în continuare de cât de bine este configurat acest mediu.

Dacă accesul nu este gestionat corect, datele nu sunt clasificate sau partajarea nu este controlată, AI va evidenția aceste vulnerabilități mult mai rapid.

De aceea, adopția AI trebuie tratată ca o decizie de infrastructură, nu doar ca implementarea unei funcționalități noi. Pentru organizațiile care vor să avanseze, prioritatea este clară: asigurarea unei fundații IT solide.

La Optimizor, ajutăm companiile să facă exact acest lucru. Evaluăm mediile Microsoft 365, identificăm riscurile și implementăm controalele necesare pentru a utiliza AI în mod sigur și eficient.

Dacă plănuiești să adopți Microsoft Copilot sau folosești deja tool-uri AI, acum este momentul potrivit să îți validezi configurația.

Izabela Matei

Izabela Matei este Marketing Managerul Optimizor, cu peste 10 ani de experiență, dintre care 3 ani în B2B IT. Este un early adopter al tehnologiilor AI, lucrând activ cu instrumente precum Microsoft Copilot și integrând AI în strategiile de digital marketing.